En ny datorsimuleringsteknik har börjat användas exempelvis inom tillverkningsindustrin. Simuleringen kallas en digital tvilling, vilket utmanar mig att levandegöra för läsaren vad något som låter så fantasieggande kan vara i verkligheten.

Den mest realistiska förklaring jag kan hitta kommer faktiskt från Harry Potters värld. Minns du kartan över Hogwarts, som inte bara visar alla rum och korridorer, utan även fotstegen i realtid av dem som smyger omkring på skolan? En liknande karta kan lätt skapas i datormiljö genom att förbinda kartan i datorn med sensorer i golvet på byggnaden som kartan avbildar. Genast har du en interaktiv digital karta över byggnaden som automatiskt uppdateras och visar människors rörelser i den. Tänk dig vidare att datorsimuleringen kan göra beräkningar som förutsäger folksamlingar som överstiger myndigheternas rekommendationer, och att den automatiskt sänder ut varningsmeddelanden via ett högtalarsystem. Såvitt jag förstår kan en sådan interaktiv digital karta kallas en digital tvilling för ett intelligent hus.

Naturligtvis är detta en revolutionerande teknik. Arkitektens ritning i något datorprogram får förlängt liv i såväl produktionen som underhållet av byggnaden. Den digitala simuleringen kopplas till sensorer som uppdaterar simuleringen med aktuella data om relevanta faktorer i byggprocessen och därefter i den färdiga byggnaden. Huset får en digital tvilling som under byggnadens hela livscykel automatiskt kontaktar underhållstekniker när sensorerna visar att tvättmaskinerna börjar bli slitna eller luften inte cirkulerar som den ska.

Användningsområdet för digitala tvillingar är enormt. Poängen med dem, som jag förstår det, är inte att de är ”exakta virtuella kopior av verkligheten”, vad det nu kunde betyda. Poängen är att datorsimuleringen är sammanlänkad med det simulerade objektet på ett praktiskt relevant sätt. Sensorer uppdaterar automatiskt simuleringen med relevanta data, samtidigt som simuleringen automatiskt uppdaterar det simulerade objektet på relevanta sätt. Samtidigt uppdateras användare, tillverkare, underhållstekniker och andra aktörer, som lätt överblickar objektets aktuella status, möjligheter och risker, var de än befinner sig i världen.

Det europeiska flaggskeppsprojektet Human Brain Project planerar att utveckla digitala tvillingar till mänskliga hjärnor, detta genom att bygga virtuella hjärnor i datormiljö. I en artikel undersöker filosoferna Kathinka Evers och Arleen Salles, som båda arbetar i projektet, de enorma utmaningar som det skulle innebära att utveckla digitala tvillingar till levande mänskliga hjärnor. Är det ens tänkbart?

Författarna jämför typer av föremål som kan få digitala tvillingar. Det kan handla om artefakter såsom byggnader och bilar eller om naturliga livlösa företeelser såsom berggrunden vid en gruva. Men det skulle alltså även kunna handla om levande ting såsom hjärtat eller hjärnan. Jämförelserna i artikeln visar att hjärnan utmärker sig på flera sätt, som alla gör det oklart om det är rimligt att tala om digitala tvillingar till mänskliga hjärnor. Vore det mer klargörande att tala om digitala kusiner?

Hjärnan är astronomiskt komplex och trots ny kunskap om den så är den i hög grad ogenomskinlig för vårt kunskapssökande. Hur kan vi tala om en digital tvilling till något som är komplext som en galax och okänt som ett svart hål? Dessutom är hjärnan genomgående dynamiskt interaktiv. Den är sammankopplad inte bara med kroppen utan även med kultur, samhälle och omvärld, som den utvecklas i oavbrutet samspel med. Hjärnan smälter närmast ihop med omgivningen. Betyder det att en digital tvilling skulle behöva vara en tvilling till hjärnan-kroppen-kulturen-samhället-världen, det vill säga en digital tvilling till allting?

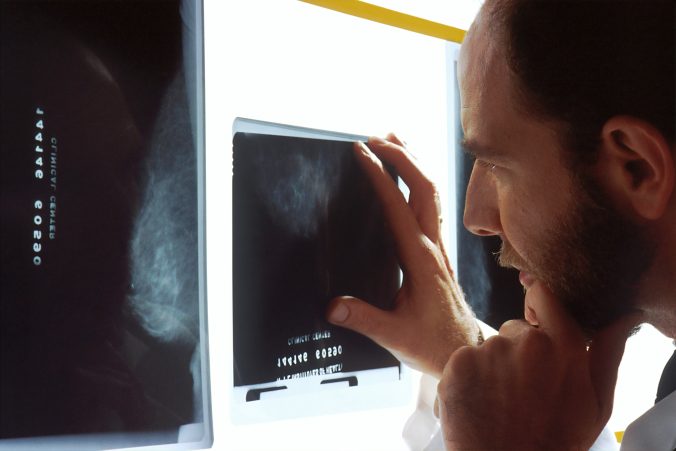

Nej, så är det naturligtvis inte. Syftet inom projektet är att finna specifika medicinska tillämpningar av den nya datorsimuleringstekniken. Genom att utveckla digitala tvillingar till vissa aspekter av vissa delar av patienters hjärnor, hoppas man kunna förbättra och individanpassa exempelvis kirurgiska ingrepp vid sjukdomar såsom epilepsi. Liksom kartan från Harry Potters värld följer människors fotsteg, skulle den digitala hjärntvillingen kunna följa vissa nervimpulsers utbredning i vissa delar av patientens hjärna. Detta kan öppna nya möjligheter att överblicka, diagnostisera, förutse och behandla sjukdomar såsom epilepsi.

Borde vi undvika termen digital tvilling när vi talar om hjärnan? Ja, det vore antagligen klokare att tala om digitala syskon eller om digitala kusiner, argumenterar Kathinka Evers och Arleen Salles. Även om experterna på området förstår begreppets tekniska användning, är uttrycket ”digital tvilling” språkligt riskabelt när vi talar om den mänskliga hjärnan. Det leder lätt tanken vilse. Vi tänker oss att den digitala tvillingen måste vara en exakt kopia av en människas hela hjärna. Detta riskerar att skapa orealistiska förväntningar och grundlös rädsla omkring teknikutvecklingen. Historien visar dessutom att språket rymmer fler faror. Ord kommer med normativa förväntningar som kan få etiska och sociala konsekvenser som kanske inte avsågs. Att tala om en digital tvilling till en gruvborr är nog ingen större språklig fara. Men handlar det om individuella människors hjärnor, kan talet om digitala tvillingar bli en ny språklig arena där vi befäster fördomar och sprider rädslor.

Efter att ha läst några populärvetenskapliga förklaringar av digital tvillingar vill jag tillägga att försiktighet kan behövas även i anknytning till industriella tillämpningar. För den digitala tvillingen till gruvborren är ju ingen ”exakt virtuell kopia av den verkliga borren” i någon absolut mening, ända ner till rörelserna hos enskilda atomer. Den digitala tvillingen är en kopia i den praktiska mening som tillämpningen gör relevant. Ibland räcker det att kopiera var människor sätter ner sina fötter, som i Harry Potters värld, vars magi oväntat hjälper oss att förstå begreppet digital tvilling mer realistiskt än många verbala ordförklaringar kan göra. Att förklara ord med hjälp av andra ord är inte alltid klargörande, om alla orden styr tanken i samma riktning. Orden ”kopia” och ”replik” leder vårt tänkande precis lika rätt och precis lika fel som ordet ”tvilling” gör.

Vill du bättre förstå utmaningarna kring digitala tvillingar till mänskliga hjärnor och vikten av begreppslig klarhet kring utvecklingen, läs den filosofiskt upplysande artikeln: Epistemic Challenges of Digital Twins & Virtual Brains: Perspectives from Fundamental Neuroethics.

Evers, Kathinka & Salles, Arleen. (2021). Epistemic Challenges of Digital Twins & Virtual Brains: Perspectives from Fundamental Neuroethics. SCIO: Revista de Filosofía. 27-53. 10.46583/scio_2021.21.846

Detta inlägg på engelska

Vi söker klarhet